Sommario:

- Autore John Day day@howwhatproduce.com.

- Public 2024-01-30 10:03.

- Ultima modifica 2025-01-23 14:49.

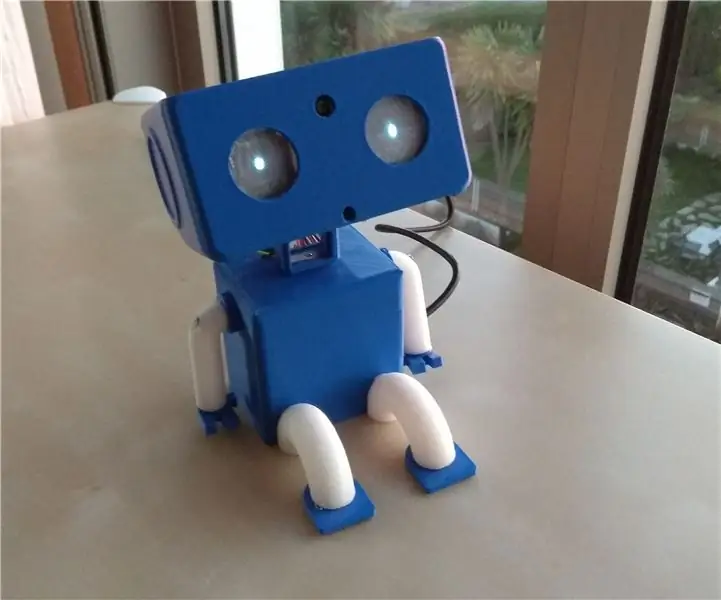

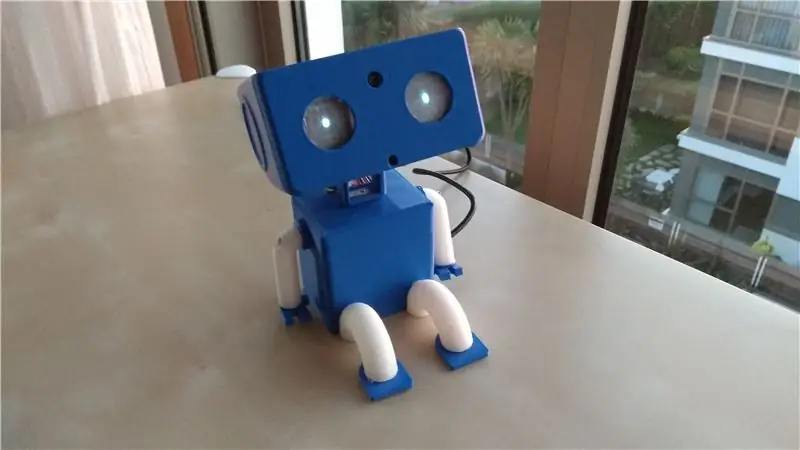

Volevo creare un giocattolo per mio figlio, un giocattolo che potesse interagire facilmente, quindi ho pensato di realizzare un robot che facesse il facetracking, che potesse interagire con lui attraverso il tatto ed esprimere emozioni.

Non ho molta conoscenza del design 3D, quindi ho iniziato con un design che ho trovato in un thingiverse che potrebbe essere adattato alle mie esigenze utilizzando Tinkerkad (https://www.tinkercad.com/things/1Qq7jjOXoHh) e (https://www.tinkercad.com/things/hJjcvy2X9Oy)

Il piccolo Timmy segui con la testa le persone che gli stanno davanti, puoi accarezzargli la testa ed emetterà suoni di emozione, e se accarezzerai più volte la sua testa, mostrerà i cuori nei suoi occhi.

Puoi programmare nuovi comportamenti, ad esempio, riconoscimento vocale come Alexa, seguire con oggetti diversi per la testa…

Passaggio 1: prima raccogli tutte le parti e gli strumenti

1 lampone pi 3

1 fotocamera Raspberry Pi

1 Arduino o Genuino Nano V3.0 ATmega328

1 cavo mini usb

2 servi sg90 (per pan e tilt)

2 mini oled 128x64 pixel (per gli occhi)

1 cicalino (per suono)

1 sensore touch (per interagire con il robot)

1 scudo per arduino nano

Molti connettori per cavi Dupont F/F

Pezzi stampati

Passaggio 2: impostazioni di stampa 3D

Little Timmy è molto facile da stampare, ho usato il colore blu su testa e corpo, e il colore bianco su mani e gambe, per gli occhi un filamento trasparente usato, I file modificati per il giocattolo sono in https://www.thingiverse.com/thing:2655550 e i file originali sono in

Il mio Tinkerkad (https://www.tinkercad.com/things/1Qq7jjOXoHh) e (https://www.tinkercad.com/things/hJjcvy2X9Oy)

Le impostazioni sono:

Zattere: No

Supporta: No

Risoluzione: 0, 2mm

Riempimento: 20%

Passaggio 3: assemblaggio

La prima cosa è unire braccia, mani, gambe e piedi ho usato delle piccole viti che avevo in casa, anche se si può usare la colla.

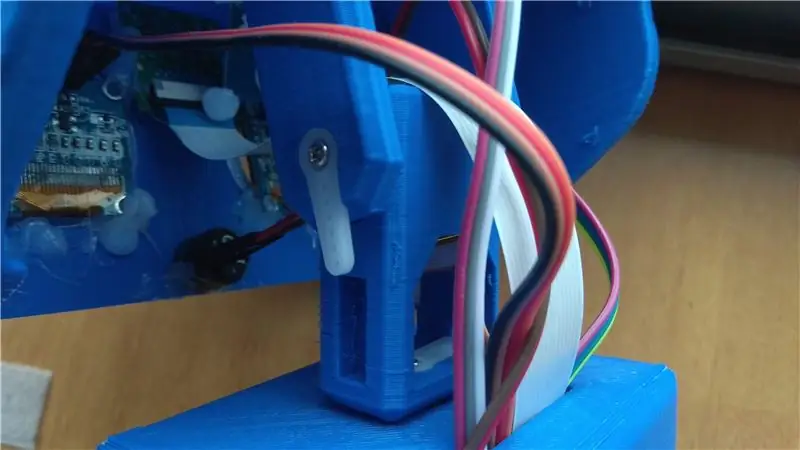

Il secondo è mettere i servi per fare un tegame e sbattere con la testa. Un servo è all'interno del corpo e l'altro è all'interno del collo.

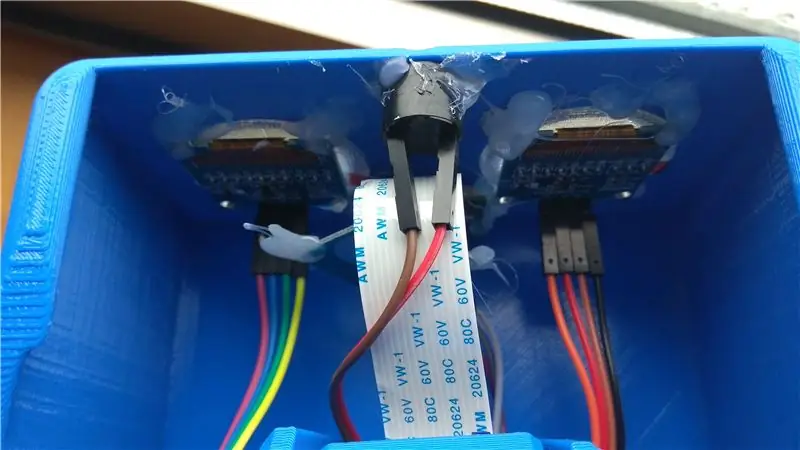

Ho usato la colla per unire gli occhi lcd, il sensore tattile, la fotocamera, il cicalino. La mia intenzione è in futuro di modificare il design per allocare i componenti senza usare la colla.

Passaggio 4: collegamento elettrico

Per facilitare la connessione ho utilizzato un Arduino Nano Shield.

Lo schema di collegamento è il seguente:

Pin D7 Sensore tattile

Pin D4 Servo asse X

PinD5 Asse Y servo

Pin D12 Buzzer

Entrambi gli schermi oled sono collegati agli stessi pin:

SDA -> A4SCL -> A5

L'Arduino e il lampone sono uniti da USB.

Passaggio 5: il codice

Per implementare il facetracking ho usato la libreria open cv in un Raspberry, ho modificato un esempio che ho trovato su github per inviare un comando ad Arduino e arduino ha controllato i servi, il sensore e gli occhi.

Per codificare il giocattolo di cui hai bisogno:

Arduino IDE

Raspberry con libreria raspbian e opencv e python.

Puoi trovare il codice Arduino e il codice Python per raspberry sul mio github (https://github.com/bhm93/littleTimmy)

Devi eseguire il programma face-track-arduino.py nel tuo lampone per attivare il facetracking.

Consigliato:

Gesture Hawk: Robot controllato con gesti della mano che utilizza un'interfaccia basata sull'elaborazione delle immagini: 13 passaggi (con immagini)

Gesture Hawk: Robot controllato con gesti della mano che utilizza un'interfaccia basata sull'elaborazione delle immagini: Gesture Hawk è stato presentato in TechEvince 4.0 come una semplice interfaccia uomo-macchina basata sull'elaborazione delle immagini. La sua utilità sta nel fatto che non sono necessari sensori aggiuntivi o indossabili tranne un guanto per controllare l'auto robotica che funziona su diversi

Come smontare un computer con semplici passaggi e immagini: 13 passaggi (con immagini)

Come smontare un computer con semplici passaggi e immagini: questa è un'istruzione su come smontare un PC. La maggior parte dei componenti di base sono modulari e facilmente smontabili. Tuttavia è importante che tu sia organizzato al riguardo. Questo ti aiuterà a non perdere parti e anche a rendere più facile il rimontaggio

Little Wizard - Gioco per PC/Android come progetto padre e figlio con i bambini (unity3d): 5 passaggi

Little Wizard - Gioco per PC/Android As Father and Son Project With Kids (unity3d): vorrei mostrare quanto sia facile e divertente creare un gioco. Ho creato il mio gioco come progetto padre e figlio, con cui passare un po' di tempo mio figlio e di imparare qualcosa di interessante da lui. Prima di tutto voglio dire che non sono uno sviluppatore di giochi e in secondo luogo che è

[Robot Arduino] Come realizzare un robot per la cattura del movimento - Pollici Robot - Servomotore - Codice sorgente: 26 passaggi (con immagini)

![[Robot Arduino] Come realizzare un robot per la cattura del movimento - Pollici Robot - Servomotore - Codice sorgente: 26 passaggi (con immagini) [Robot Arduino] Come realizzare un robot per la cattura del movimento - Pollici Robot - Servomotore - Codice sorgente: 26 passaggi (con immagini)](https://i.howwhatproduce.com/images/001/image-1599-93-j.webp)

[Robot Arduino] Come realizzare un robot per la cattura del movimento | Pollici Robot | Servomotore | Codice sorgente: Thumb Robot. Usato un potenziometro del servomotore MG90S. È molto divertente e facile! Il codice è molto semplice. Sono solo circa 30 linee. Sembra una cattura del movimento. Si prega di lasciare qualsiasi domanda o feedback! [Istruzioni] Codice sorgente https://github.c

Costruisci un robot molto piccolo: crea il robot a ruote più piccolo del mondo con una pinza.: 9 passaggi (con immagini)

Costruisci un robot molto piccolo: crea il robot a ruote più piccolo del mondo con una pinza: costruisci un robot da 1/20 di pollice cubo con una pinza che può raccogliere e spostare piccoli oggetti. È controllato da un microcontrollore Picaxe. A questo punto, credo che questo potrebbe essere il robot su ruote più piccolo al mondo con una pinza. Questo senza dubbio ch